本项目展示了一种基于 3D 高斯的场景表示和实际监控视角下的数字人的绑定方法。该方法首先通过原始视频和位置识别技术,提取出场景中的人体信息,将人体信息映射到数字人上,实现了场景中人体的实时绑定

本项目展示了一种基于 3D 高斯的场景表示和实际监控视角下的数字人的绑定方法。该方法首先通过原始视频和位置识别技术,提取出场景中的人体信息,将人体信息映射到数字人上,实现了场景中人体的实时绑定

本项目展示了一种大场景 3D 高斯渲染方法,对东北大学校园内多个场景进行 3D 高斯重建

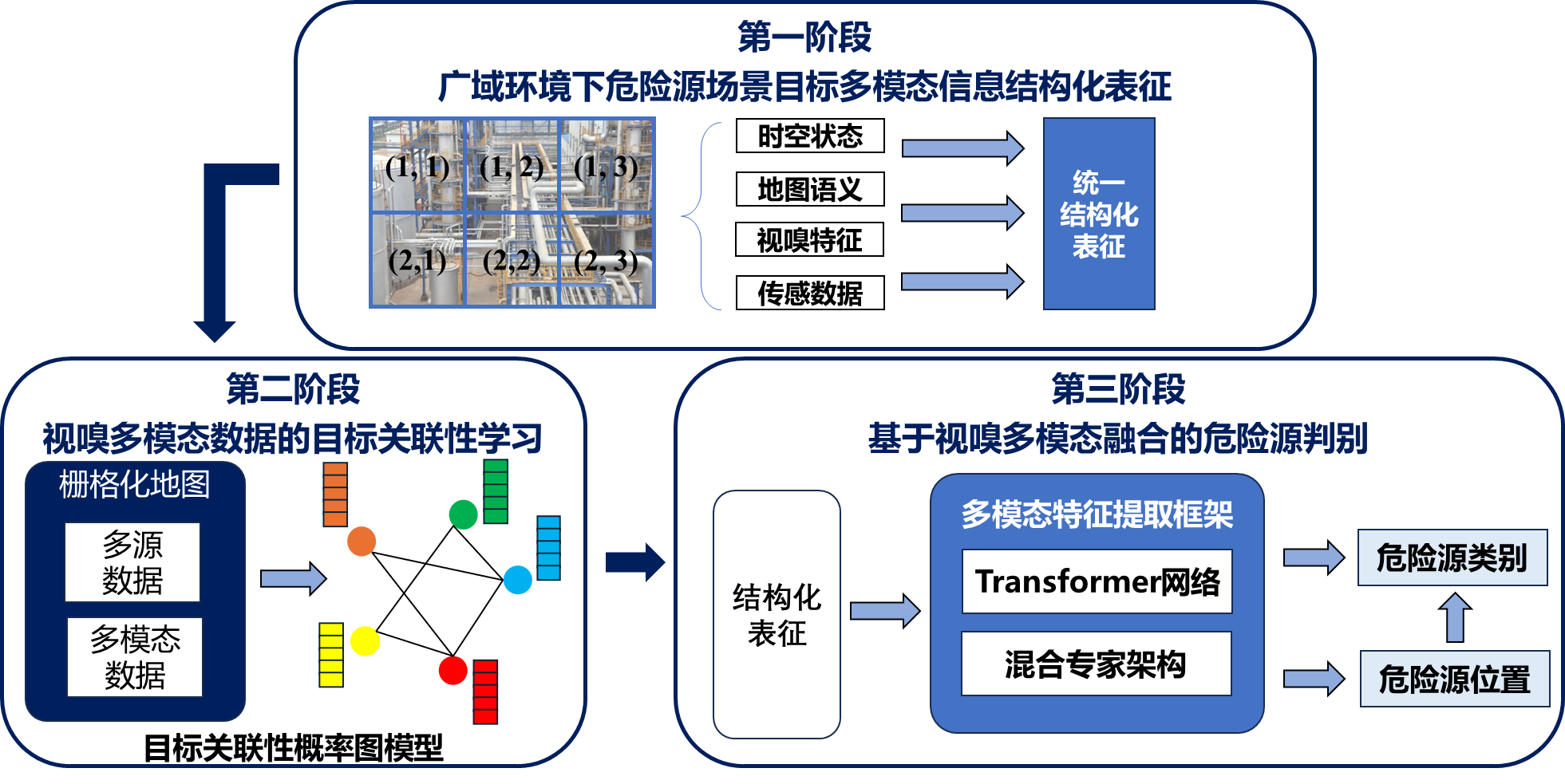

广域环境下的各类危险源在目标特点、时空范畴和关联模式方面存在较大的差异性,很难直接利用深度学习模型实现基于视嗅多模态信息的有效融合,进而影响危险源判别的准确性和可靠性。本课题针对这一难题,提出广域环境视嗅多模态融合危险源判别方法

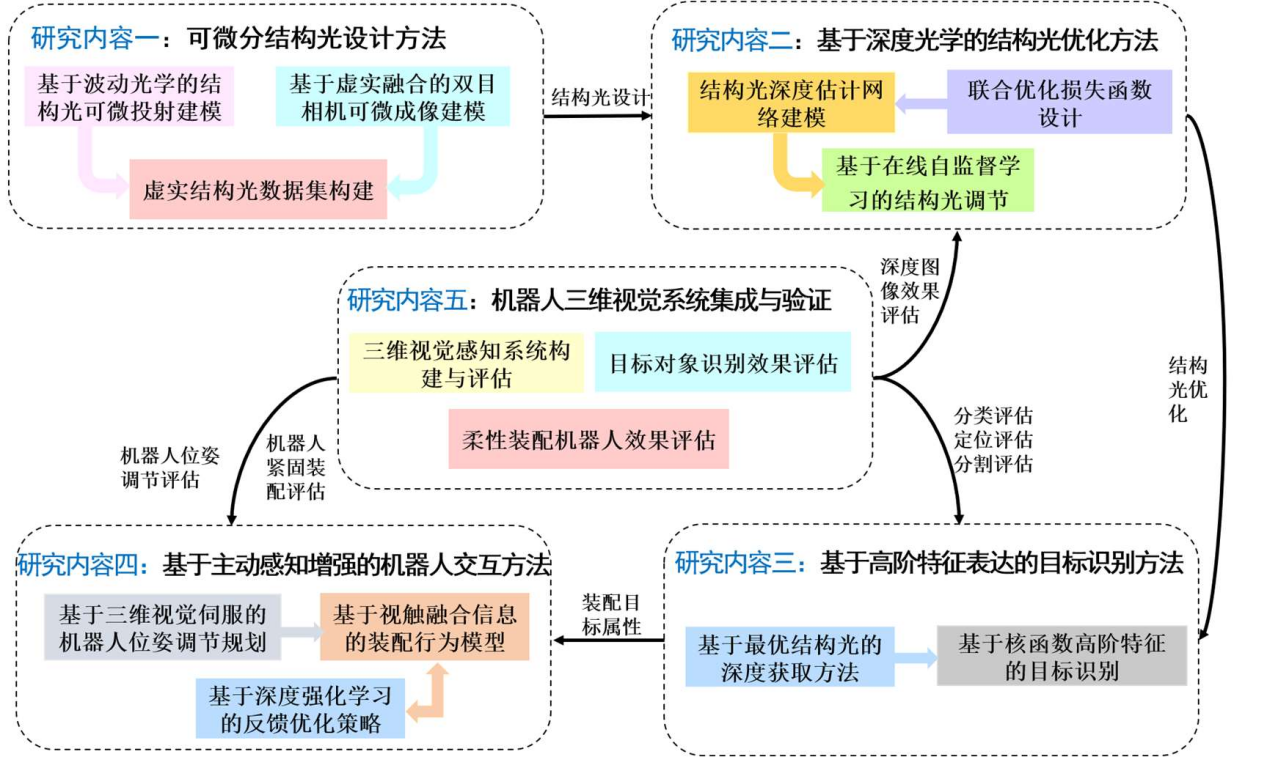

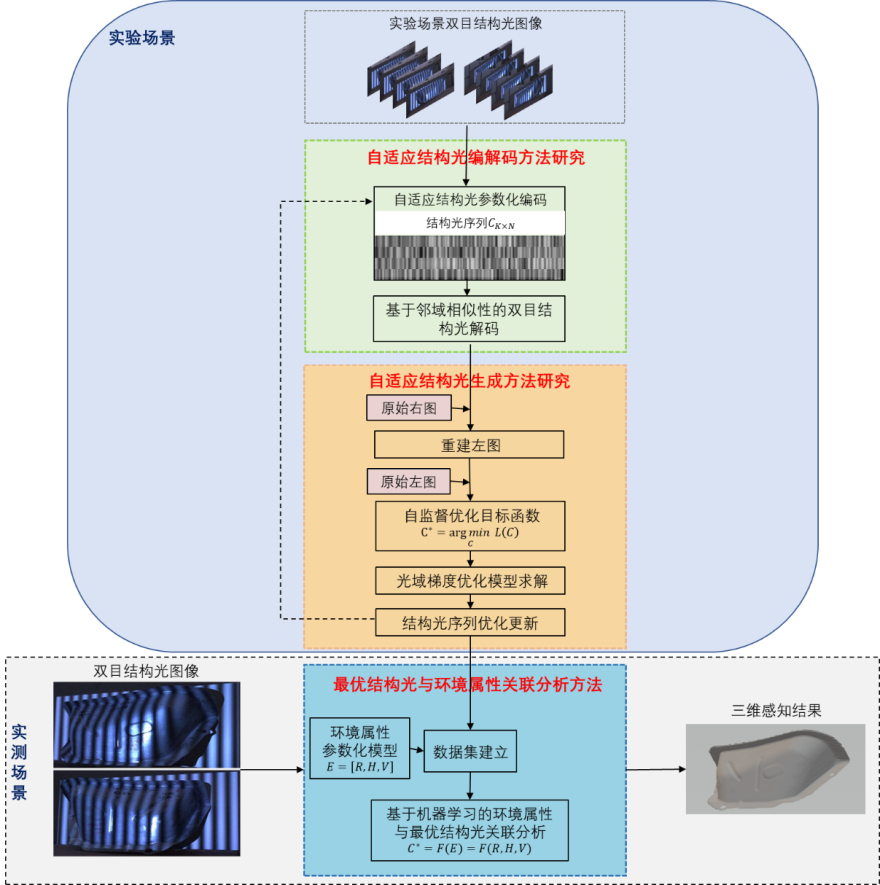

本项目围绕联合基金“可变环境下三维主动视觉精准感知”目标,对结构光成像模型可微性、结构光与目标环境联合优化、复杂任务驱动下机器人感知与行为交互机制等关键科学问题展开深入研究

现有方法多集中于对固定结构光的研究与应用,已无法适应小批量、个性化等柔性生产模式产生的复杂工业环境变化的影响。为此,本项目融合主动视觉、双目立体、机器学习等领域,探索结构光模型适应环境变化的机制,力争实现机器人高精度、高鲁棒、快速的三维视觉感知