广域环境视嗅多模态融合危险源判别方法研究

项目简介

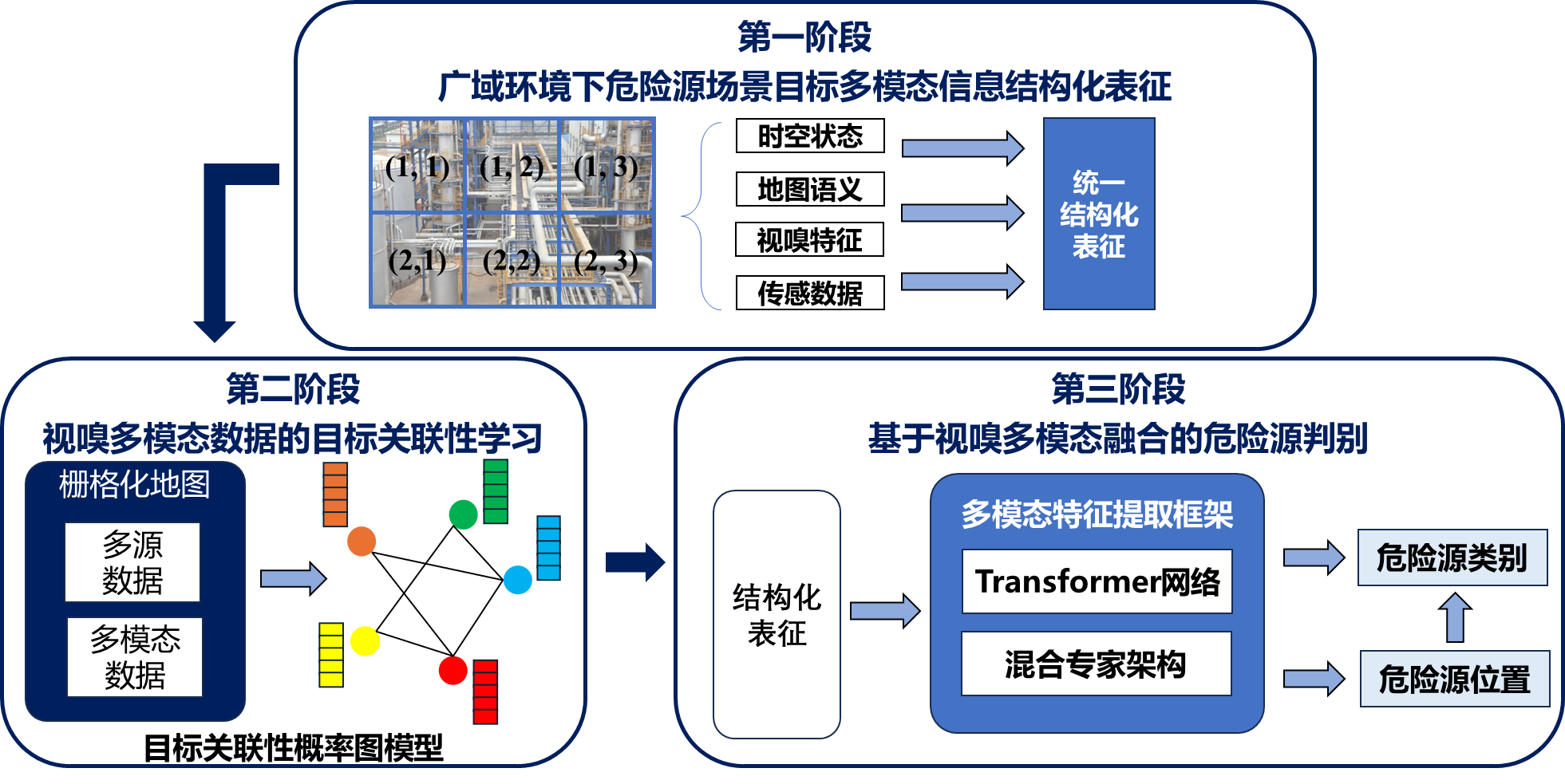

广域环境下的各类危险源在目标特点、时空范畴和关联模式方面存在较大的差异性,很难直接利用深度学习模型实现基于视嗅多模态信息的有效融合,进而影响危险源判别的准确性和可靠性。本课题针对这一难题,提出广域环境视嗅多模态融合危险源判别方法。首先,研究包含数据、特征、语义与状态的多层结构化表征模型,提升小样本条件下视嗅传感数据跨模态表征的一致性与可靠性。其次,提出视嗅多模态传感信息跨时空关联性学习方法,提升危险源判别依据的全面性与可靠性。最后,提出基于时空注意力聚合Transformer网络的多模态融合识别方法,提升危险源判别结果的正确性与可靠性。通过上述三方面的研究工作,为后续的广域环境下视嗅协同自主巡检取证一体化作业机器人集成与功能实现提供全面、可靠、准确的视嗅多模态融合危险源判别结果

研究内容